Ciência e Tecnologia

14 de junho de 2022

Inteligência artificial Dall-E viraliza na internet com técnica de criação de imagens

IA é capaz de entender descrições escritas em texto e transformá-las em imagens

Lançada em abril, a segunda versão do recurso de inteligência artificial (IA) batizado de Dall-E — junção do sobrenome de Salvador Dalí (pintor espanhol) e Wall-e (personagem robô criado pela Pixar) — é capaz de criar imagens extremamente precisas a partir de breves descrições escritas por usuários. A ferramenta é um modelo de machine learning (aprendizado de máquina, em tradução livre) e foi desenvolvido pela OpenAI, empresa do ramo cofundada por Elon Musk.

A primeira versão da IA foi divulgada em 2021, porém não foi tão comentada quanto a Dall-E 2. Isso porque a segunda versão é capaz de entender e traduzir em imagem descrições extremamente específicas, com alto grau de precisão e qualidade. O acesso à Dall-E 2, no entanto, ainda está restrito a pesquisadores e um grupo seleto de usuários.

Outras plataformas semelhantes à Dall-E

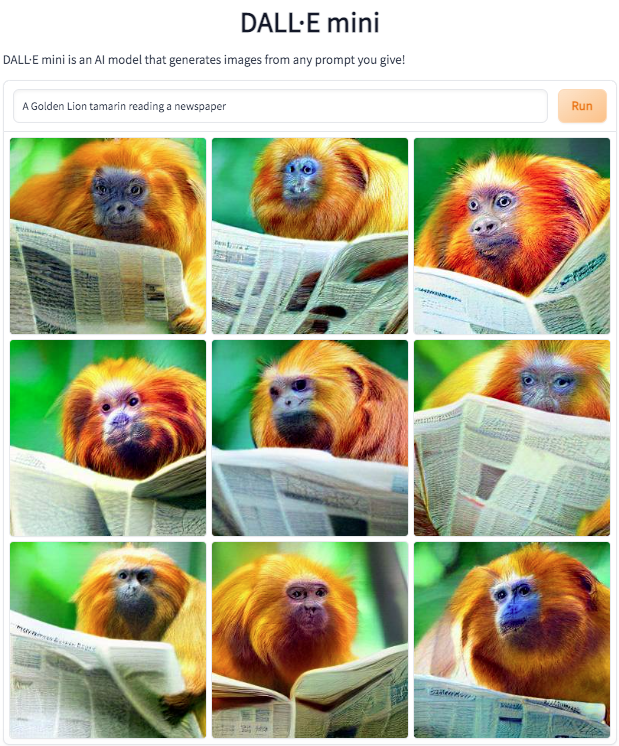

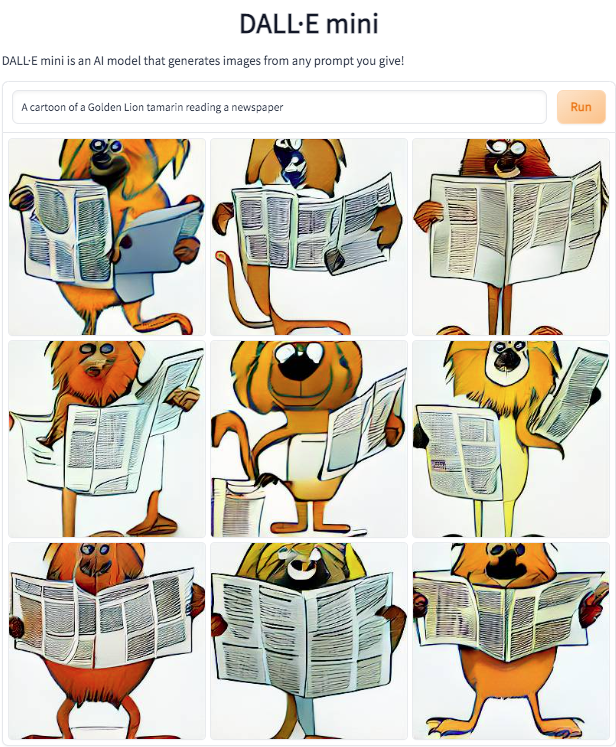

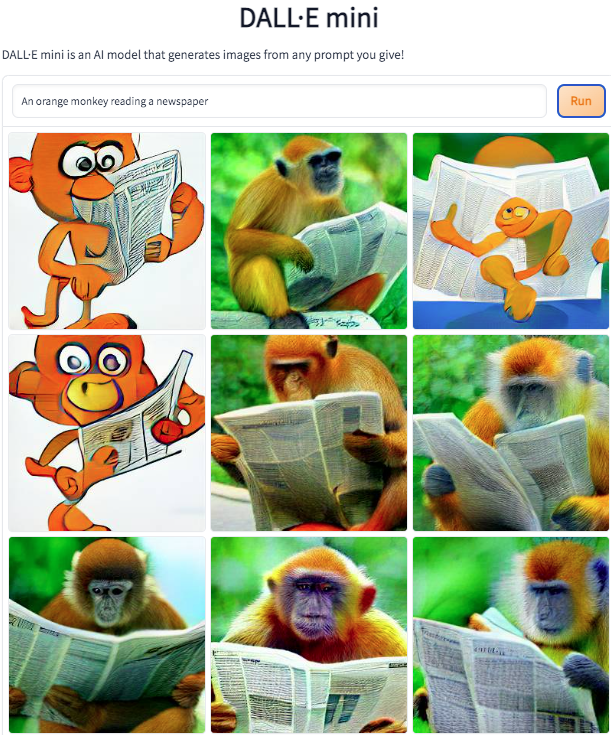

Apesar de a Dall-E 2 ser destaque entre os modelos de IA de geração de imagem, a OpenAI não foi a única a criar esse tipo de programa. O Google, por exemplo, também está desenvolvendo um programa concorrente da Dall-E, chamado Imagen. Além disso, há programas de uso livre disponíveis na internet, como a Dream, da Wombo, e a Dall-E Mini, criada pelo desenvolvedor Boris Dayma e cujo sistema se assemelha “a primeira versão da IA da Dall-E.

O que é machine learning?

Modelo de inteligência artificial capaz de observar grande quantidade de dados e identificar padrões entre eles. No caso da Dall-E 2, depois de interpretar os padrões entre imagens e textos, a IA consegue produzir conteúdos novos, a partir do que foi identificado pelos algoritmos.

Imagem gerada pelo Wall-E Mini, com a descrição em inglês: “Um mico-leão-dourado lendo um jornal” (imagem: Dall-E Mini/reprodução)

Imagem gerada pelo Wall-E Mini, com a descrição em inglês: “Desenho de um mico-leão-dourado lendo um jornal” (imagem: Dall-E Mini/reprodução)

Imagem gerada pelo Wall-E Mini, com a descrição em inglês: “Um macaco laranja lendo um jornal”(imagem: Dall-E Mini/reprodução)

Fontes: UOL, Shifter e OpenAI.

Ixi! Você bateu no paywall!

Ainda não é assinante? Assine agora e tenha acesso ilimitado ao conteúdo do Joca.

Você precisa fazer o login para publicar um comentário.